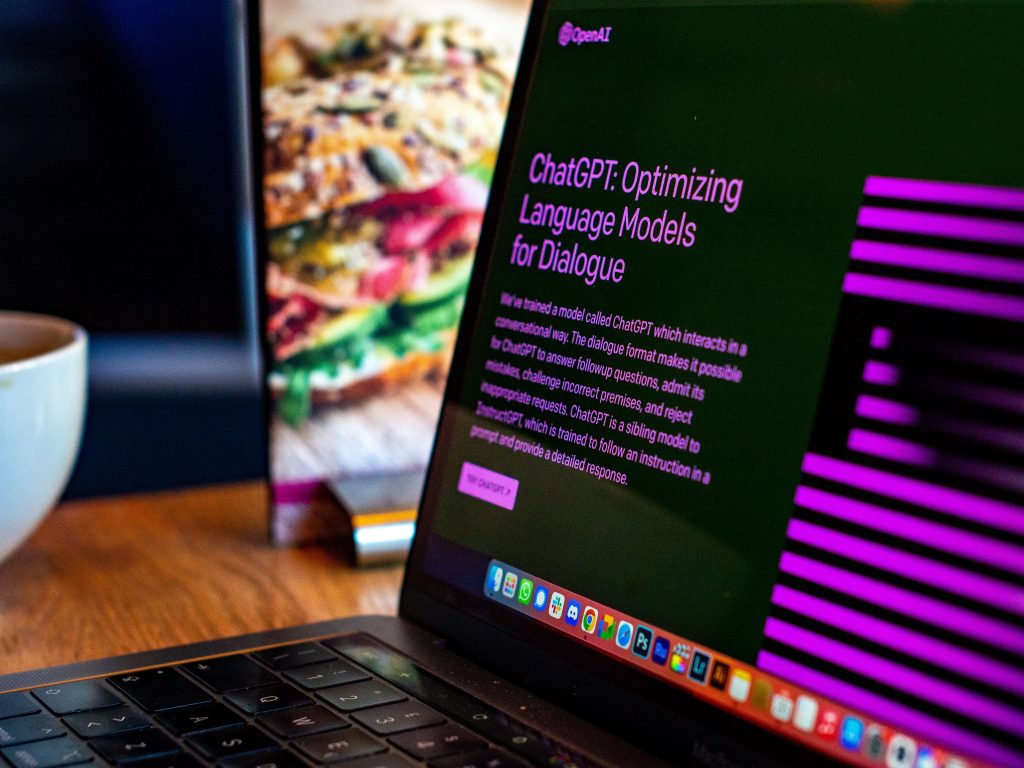

في عالم يشهد تقدمًا سريعًا في مجال الذكاء الاصطناعي، تكمن أهمية وثيقة مبادئ أخلاقيات الذكاء الاصطناعي في توجيهنا نحو استخدام تكنولوجيا الذكاء الاصطناعي بطريقة أخلاقية ومسؤولة. إنها الخطوة التي تؤكد على أننا نضع البشرية وقيمها في صلب تطور التكنولوجيا الحديثة.

تعد وثيقة مبادئ أخلاقيات الذكاء الاصطناعي تعبيرًا عن الجهود العالمية لتحديد المبادئ الأخلاقية التوجيهية لتطوير واستخدام الذكاء الاصطناعي.

تمثل هذه الوثيقة أصواتًا متعددة من المجتمع العلمي والتقني والأخلاقي، تسعى للتوازن بين التقدم التكنولوجي والحفاظ على القيم الأخلاقية والحقوق الإنسانية.

تضم وثيقة مبادئ أخلاقيات الذكاء الاصطناعي مجموعة من المبادئ الأساسية التي يجب أن تتحكم في تصميم وتطوير الأنظمة الذكاء الاصطناعي.

تشمل هذه المبادئ احترام الكرامة البشرية، والعدالة، والشفافية، والمساءلة، والاحترام للخصوصية والأمان، والتنوع والشمول.

تعتبر وثيقة مبادئ أخلاقيات الذكاء الاصطناعي إطارًا قويًا يوجه المطورين والمشغلين والمستخدمين لتقنيات الذكاء الاصطناعي.

فهي تسلط الضوء على ضرورة ضمان أن تكون تلك التقنيات مفيدة وأخلاقية وتعمل على تعزيز رفاهية البشرية بشكل عام.

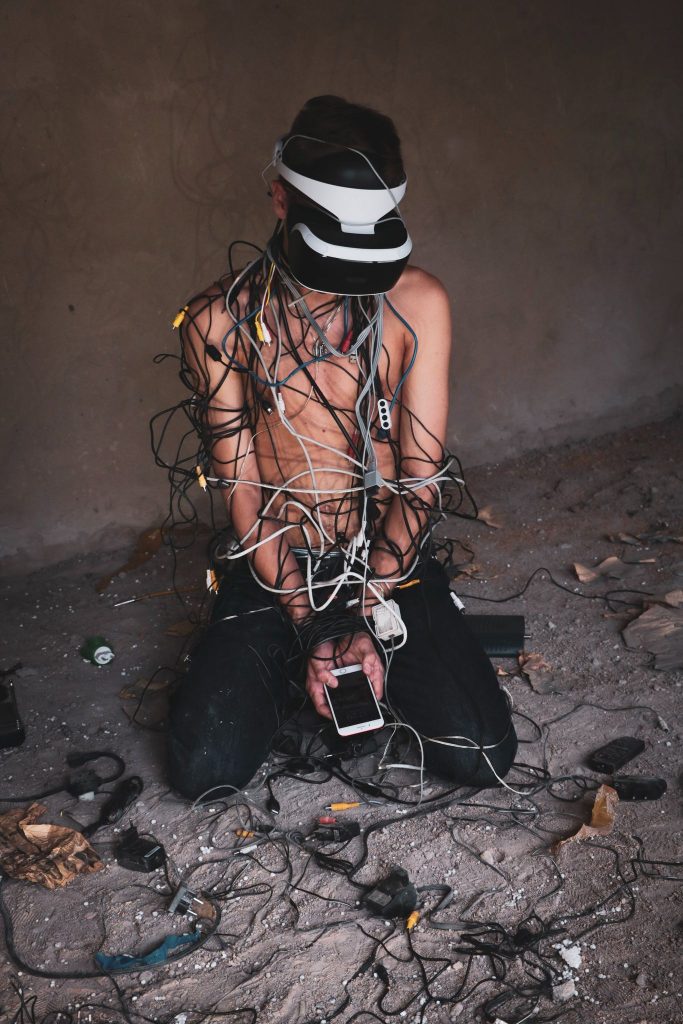

إن وثيقة مبادئ أخلاقيات الذكاء الاصطناعي تعكس التحديات المعقدة التي تواجهنا في هذا العصر الرقمي المتطور. ومن خلال توفير إرشادات وتوجيهات واضحة، تساهم هذه الوثيقة في بناء منظومة تكنولوجية تضمن أن تعمل التقنيات الذكاء الاصطناعي لصالح الإنسانية، وتحقق التوازن بين التقدم التكنولوجي والأخلاق.

وبالنظر إلى التحديات المستقبلية المحتملة للذكاء الاصطناعي، فإن وثيقة مبادئ الأخلاقيات توفر أساسًا قويًا للتفكير والنقاش المستمر حول كيفية تطويرتقنيات الذكاء الاصطناعي بشكل مسؤول وأخلاقي.

إنها تدعونا إلى اعتبار تأثيرات هذه التقنيات على المجتمع والثقافة والاقتصاد، وضمان أن تكون التقنيات الجديدة عادلة وشفافة ومساهمة في تعزيز التنمية الإنسانية المستدامة.

الذكاء الاصطناعي

الذكاء الاصطناعي

الذكاء الاصطناعي

فيما يلي صياغة مقترحة لوثيقة مبادئ أخلاقيات الذكاء الاصطناعي:

مقدمة:

نحن، المطورون والمستخدمون والمشرعون والمنظمون وغيرهم المعنيون بمجال الذكاء الاصطناعي، نلتزم بتوظيف واستخدام التكنولوجيا بطرق تحقق الفوائد وتحافظ على القيم الأخلاقية وتحمي المصالح العامة. تهدف هذه الوثيقة إلى تحديد المبادئ الأساسية التي يجب أن نلتزم بها في تصميم وتطوير واستخدام الذكاء الاصطناعي.

المبادئ:

الشفافية:

نلتزم بتوفير شفافية تامة بشأن استخدام الذكاء الاصطناعي وتأثيراته على الأفراد والمجتمعات.

نسعى لضمان وجود توضيحات واضحة وفهم مشترك بشأن كيفية عمل النظم الذكاء الاصطناعي وإتخاذ القرارات.

العدالة والتكافؤ:

نؤمن بأن الذكاء الاصطناعي يجب أن يكون عادلاً وغير متحيز، ولا يزيد من التمييز أو الانقسام الاجتماعي.

نسعى لتوفير فرص متساوية وعدالة في الوصول إلى التكنولوجيا وفوائدها وتجنب التفاوتات الغير مبررة.

الخصوصية والأمان:

نحافظ على حقوق الخصوصية والأمان للأفراد ونتبع المعايير العالمية في حماية البيانات ومعالجتها.

نسعى لتقديم التدابير الأمنية اللازمة لحماية النظم الذكاء الاصطناعي من التهديدات الأمنية والاختراقات.

المساءلة والمسؤولية:

نحمل المسؤولية عن تصميم وتطوير واستخدام الذكاء الاصطناعي وآثاره على الأفراد والمجتمعات.

نسعى لتطبيق آليات المساءلة والإشراف وتقييم التأثيرات الأخلاقية والاجتماعية للذكاء الاصطناعي.

نحترم الحقوق والحريات الأساسية للأفراد ونسعى لتقليل الآثار السلبية المحتملة للتكنولوجيا.

التنوع والشمول:

نسعى لتعزيز التنوع في تطوير واستخدام الذكاء الاصطناعي لتجنب التمييز والتحيز.

نحرص على ضمان شمولية التكنولوجيا وتوافرها لجميع الفئات الاجتماعية والثقافية والاقتصادية.

الاحترام والتعاون:

نحترم الكرامة البشرية والتنوع ونعمل على تعزيز التعاون بين جميع الأطراف المعنية بالذكاء الاصطناعي.

نشجع على الحوار المفتوح والبناء وتبادل المعرفة والتجارب لتعزيز الممارسات الأخلاقية.

الشفافية في القرارات:

نلتزم بتوضيح وتفسير قرارات الذكاء الاصطناعي بشكل مفهوم وشفاف للأفراد المتأثرين بها.

نسعى لتوفير آليات للتفسير والتوضيح والتعديل في حالة حدوث أخطاء أو آثار غير مرغوب فيها.

المسؤولية الاجتماعية:

نحث على تبني التكنولوجيا الاجتماعية واستخدام الذكاء الاصطناعي للمساهمة في حل المشكلات الاجتماعية وتحقيق التنمية المستدامة.

نشجع على تعزيز الابتكار الاجتماعي وتوجيه الجهود نحو تحقيق الفوائد العامة وتحسين جودة الحياة.

التدريب والتعليم:

نسعى لتوفير التدريب والتعليم المستمر للمطورين والمستخدمين والمشرعين لزيادة الوعي بأخلاقيات الذكاء الاصطناعي وتعزيز الممارسات الأخلاقية.

نحث على تضمين مفاهيم الذكاء الاصطناعي والأخلاقيات ذات الصلة في المناهج التعليمية والبرامج التدريبية.

الابتكار المستدام:

نشجع على تطوير واستخدام الذكاء الاصطناعي بطرق تحقق التنمية المستدامة وتحسين الأداء البيئي والاجتماعي والاقتصادي.

نلتزم بتقديم الحلول التكنولوجية المستدامة وتقليل الآثار البيئية السلبية للذكاء الاصطناعي.

الإشراف والمراقبة:

نحث على وجود إطار قانوني وأخلاقي للإشراف والمراقبة الفعالة لنظم الذكاء الاصطناعي.

نسعى لتوفير آليات وآليات تفتيش وتقييم النظم الذكاء الاصطناعي للتأكد من الامتثال للمعايير الأخلاقية والقانونية.

الحوكمة والتعاون الدولي:

ندعم التعاون الدولي وتبادل المعرفة والممارسات الأفضل لتطوير إطار قانوني وأخلاقي للذكاء الاصطناعي.

نحرص على وجود آليات للتنسيق والتعاون الدولي للتطوير معايير الأخلاقيات والسياسات المتعلقة بالذكاء الاصطناعي.

الخصوصية وحماية البيانات:

نلتزم بحماية خصوصية المستخدمين والبيانات الشخصية المتعلقة بالذكاء الاصطناعي ونتبع أفضل الممارسات لحماية البيانات والتعامل معها بشكل آمن ومسؤول.

نسعى لتحقيق التوازن بين استخدام البيانات لأغراض الذكاء الاصطناعي وحماية خصوصية المستخدمين وضمان التحكم في استخدام البيانات بموافقة المستخدمين.

التنوع والتمثيلية:

نحرص على تعزيز التنوع والتمثيلية في تطوير واستخدام الذكاء الاصطناعي لتجنب التحيز والتمييز والظلم الاجتماعي.

نسعى لتجنب تكريس النماذج النمطية وضمان تمثيل متنوع لمختلف الجنسيات والثقافات والخلفيات في تصميم وتدريب نظم الذكاء الاصطناعي.

الأمن والسلامة:

نلتزم بتطوير واستخدام الذكاء الاصطناعي بطرق تضمن الأمان والسلامة للمستخدمين والمجتمع بشكل عام.

نحث على اختبار وتقييم النظم الذكاء الاصطناعي للكشف عن ثغرات الأمان ومعالجتها قبل إطلاقها في الإنتاج.

العدالة والمساواة:

نسعى لضمان عدالة استخدام الذكاء الاصطناعي وعدم تفاقم الاختلافات الاجتماعية والاقتصادية القائمة.

نحرص على تقديم فرص متساوية للجميع في الوصول إلى التكنولوجيا والاستفادة منها دون تمييز أو تحيز.

التفاعل الإنسان-الآلة:

نؤكد على أهمية تصميم وتطوير واجهات مستخدم سهلة الاستخدام وتفاعلية مع النظم الذكاء الاصطناعي.

نحث على تعزيز التفاعل الإنسان-الآلة السلس والفعال وتعزيز التعاون بين الناس والأنظمة الذكاء الاصطناعي.

في الختام، تعد وثيقة مبادئ أخلاقيات الذكاء الاصطناعي رمزًا للالتزام ببناء مستقبل يتمتع بتواجد آمن ومزدهر للذكاء الاصطناعي.

إنها الإطار الذي يوجهنا نحو تحقيق التوازن بين التقدم التكنولوجي والأخلاق والقيم الإنسانية، لنضمن أن يكون الذكاء الاصطناعي شريكًا لنا في بناء عالم أفضل للجميع.

المراجع

Bostrom, N., & Yudkowsky, E. (2014). The ethics of artificial intelligence. Cambridge Handbook of Artificial Intelligence, 316-334.

Floridi, L., & Sanders, J. W. (Eds.). (2016). The ethics of artificial intelligence. Elsevier.

Russell, S. J., & Norvig, P. (2016). Artificial intelligence: A modern approach. Pearson.

Jobin, A., Ienca, M., & Vayena, E. (2019). The global landscape of AI ethics guidelines. Nature Machine Intelligence, 1(9), 389-399.

European Commission High-Level Expert Group on Artificial Intelligence. (2019). Ethics guidelines for trustworthy AI. Retrieved from https://ec.europa.eu/…/ethics-guidelines-trustworthy-ai

Institute of Electrical and Electronics Engineers (IEEE). (2020). Ethically Aligned Design: A Vision for Prioritizing Human Well-being with Artificial Intelligence and Autonomous Systems. Retrieved from https://ethicsinaction.ieee.org/

Partnership on AI. (2017). Partnership on AI’s tenets. Retrieved from https://www.partnershiponai.org/tenets/

World Economic Forum. (2020). Global AI Action Alliance: Shaping a global framework on artificial intelligence and machine learning. Retrieved from https://www.weforum.org/…/global-ai-action-alliance…/

جريدة الأهرام الجديد الكندية

جريدة الأهرام الجديد الكندية

جزاكم الله خيرا. قال صلى الله عليه وسلم( أقربهم مني منزلة يوم القيامة احاسنكم اخلاقا). اي عمل لاتوجه القيم فهو رد .لأننا مكلفون ومستخلفون. والقيم هي مكون معرفي وعقلي ونفسي وجداني واداي يدفع لفعل الخير وينها عن فعل الشر ومصدرها رباني.بارك الله فيكم ونفع بكم ودمتم منارة للتربية.